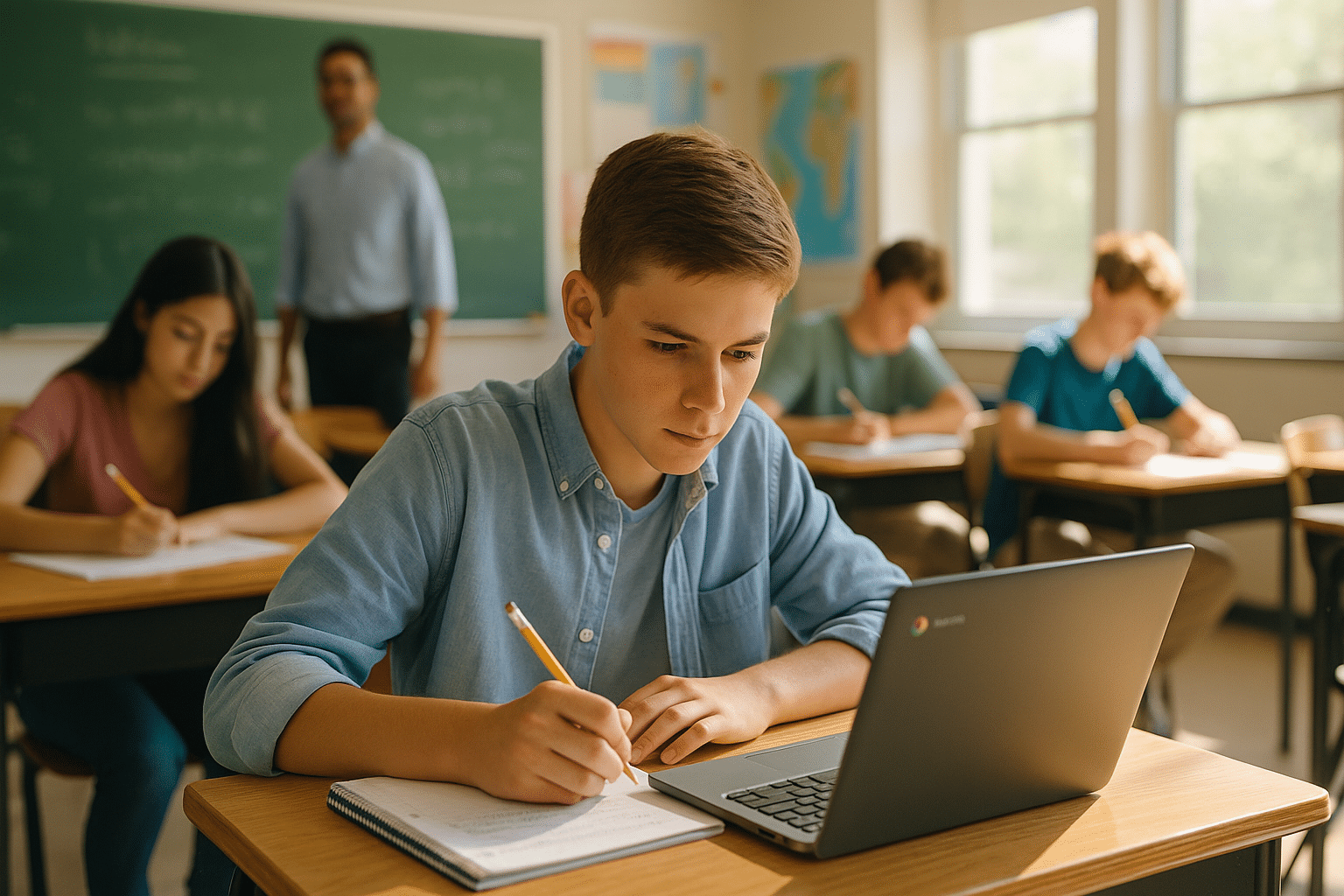

Depuis la rentrée 2024-2025, l’usage des outils d’intelligence artificielle s’est installé dans les collèges, lycées et universités. Plusieurs enquêtes menées en Europe et aux États-Unis montrent une même dynamique : les enseignants s’inquiètent, les élèves expérimentent et les établissements réécrivent en urgence leurs règles. Rien ne prouve une explosion massive de la fraude ou une hausse spectaculaire des notes, mais un fait demeure : l’IA transforme l’apprentissage plus vite que l’école ne parvient à s’adapter.

Une adoption massive mais invisible

Les données publiées au cours de l’année 2025 convergent toutes vers un constat : une grande partie des élèves a déjà recours à l’IA dans son travail scolaire. En France, une enquête menée dans les grandes écoles souligne que beaucoup d’étudiants utilisent ces outils pour reformuler, structurer ou vérifier un devoir. Aux États-Unis, des établissements rapportent des situations similaires, sans pouvoir en mesurer précisément l’ampleur. Ce n’est plus une technologie périphérique, mais une présence discrète, omniprésente. Les outils intégrés dans les navigateurs ou les systèmes d’exploitation permettent d’analyser et d’expliquer un texte en quelques secondes. Là réside le cœur du problème : l’usage réel de l’IA devient indétectable. Les enseignants voient apparaître des copies plus homogènes, plus propres, mais ne peuvent déterminer à quel point elles résultent d’un travail personnel ou d’une assistance technologique. Les observations recueillies sur le terrain évoquent plusieurs symptômes :

– peu de fautes ou de maladresses ;

– des formulations très similaires d’un élève à l’autre ;

– un écart entre le travail écrit à domicile et celui produit en classe ;

– un style plus standardisé.

Mais jusqu’ici, aucune étude sérieuse n’a chiffré un lien direct entre l’usage de l’IA et une hausse générale des résultats. Les cas spectaculaires évoqués par certains enseignants restent anecdotiques.

Un système éducatif obligé de redéfinir ses règles

Si la fraude n’est pas mesurée, le doute, lui, est bien réel. Une partie importante des enseignants français a déjà modifié ses pratiques, que ce soit en multipliant les oraux, en revenant aux épreuves manuscrites ou en imposant des exercices réalisés sous supervision. Cette réorganisation n’est pas motivée par un phénomène massif et avéré de triche, mais par une question fondamentale : qu’évalue-t-on encore ? Depuis plus d’un siècle, l’école repose sur un principe simple : l’élève prouve sa compréhension par une production personnelle. Mais cet équilibre vacille dès lors qu’un outil peut expliquer, résoudre, structurer ou reformuler un devoir avec une qualité difficile à distinguer du travail humain. Plusieurs approches émergent :

– considérer l’IA comme une compétence à part entière, comparable à l’usage de la calculatrice ;

– sanctuariser certains examens sans outils numériques ;

– développer une pédagogie centrée sur l’analyse critique plutôt que sur la restitution ;

– former les enseignants à l’usage et aux limites de ces technologies.

Une chose est sûre : la frontière entre aide et substitution est devenue floue. Et ce flou oblige l’école à reconsidérer ses priorités.

Rien ne prouve que l’IA ait déjà fait dérailler l’école, mais tout indique qu’elle transforme profondément les conditions d’apprentissage et de contrôle. Le défi n’est plus d’empêcher les élèves d’utiliser ces outils, mais de repenser une évaluation crédible dans un environnement où l’intelligence n’est plus uniquement humaine.